Gli standard di sicurezza per AI agent sviluppati da GenGen Digital, il colosso nato dall’unione di Norton e Avast, rappresentano un insieme di linee guida tecniche pensate per rendere più sicuri gli agenti di intelligenza artificiale. Si tratta di regole “standardizzate” che servono a controllare e valutare le azioni degli agenti durante la loro esecuzione, verificando anche l’affidabilità degli strumenti (skill) utilizzati e rendendo la sicurezza coerente tra piattaforme diverse.

Tra i componenti principali troviamo:

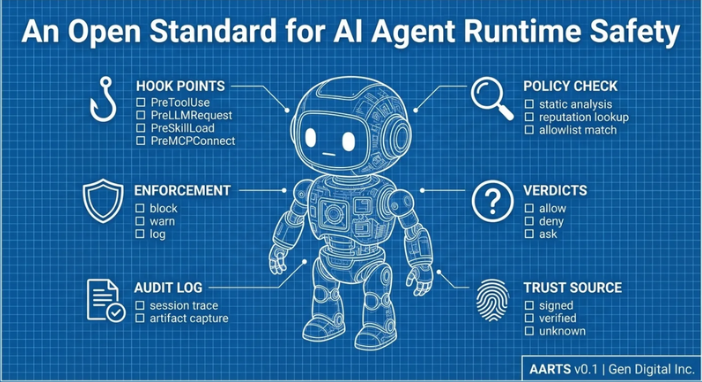

AARTS (AI Agent Runtime Safety Standard), che definisce come controllare in tempo reale le azioni degli agenti AI (allow / deny / ask).

Sistemi come gli Skill IDs, che permettono di identificare e “firmare” gli strumenti utilizzati dagli agenti, così da verificarne provenienza e integrità.

L’obiettivo è ridurre i rischi di attacchi o comportamenti malevoli, evitare che tool o plugin non sicuri vengano eseguiti e creare un linguaggio comune di sicurezza tra diversi sistemi AI. In questo senso, rappresentano una sorta di “codice della strada” per gli agenti AI, definendo regole condivise su come devono operare in modo sicuro.

Lo standard AI Agent Runtime Safety Standard

Il problema principale affrontato è la frammentazione. Ogni piattaforma di agenti espone eventi e dati diversi, rendendo difficile applicare controlli di sicurezza uniformi. La stessa azione può essere visibile e bloccabile in una piattaforma, ma completamente invisibile in un’altra, portando a protezioni incoerenti o inefficaci.

AARTS nasce per risolvere questo problema definendo uno standard aperto e neutrale, che permette a diversi sistemi di comunicare e applicare regole comuni.

Lo standard collega tre elementi principali:

- gli host (dove gira l’agente)

- gli adapter (che traducono gli eventi)

- i motori di sicurezza (che prendono decisioni)

Questa separazione consente maggiore flessibilità e portabilità delle soluzioni di sicurezza.

AARTS introduce anche dei “hook points”, cioè momenti specifici nel ciclo di vita dell’agente in cui è possibile intervenire per controllarne le azioni. Tra i più importanti ci sono quelli prima dell’uso di strumenti, prima delle richieste al modello e prima del caricamento di plugin.

Il sistema standardizza anche i dati disponibili per le decisioni, così che siano coerenti tra piattaforme diverse. Le decisioni di sicurezza possono essere: permettere, bloccare o chiedere conferma all’utente.

Lo standard prevede tre livelli di adozione (base, intermedio e completo), per facilitare un’implementazione graduale: il livello base copre le funzioni essenziali, mentre quello completo gestisce l’intero ciclo di vita dell’agente.

I rischi principali includono attacchi tramite prompt, installazioni malevole e perdita di dati sensibili. AARTS aiuta a intercettare queste minacce fornendo più contesto e punti di controllo.

Tuttavia, lo standard prevede anche un comportamento detto “fail-open”: se il motore di sicurezza non riesce a rispondere (ad esempio per un errore o un ritardo), l’azione viene comunque consentita. Questa scelta privilegia la continuità operativa, ma introduce un rischio, perché azioni potenzialmente pericolose potrebbero essere eseguite senza verifica.

Restano inoltre alcune questioni aperte, come la tutela della privacy, l’affidabilità degli adapter e la gestione delle decisioni nei contesti senza interazione diretta con l’utente.

Insomma, AARTS punta a creare un ecosistema più sicuro e coerente per gli agenti AI, rendendo la sicurezza portabile tra diverse piattaforme.